黄仁勲GTC講演全文:推論の時代が到来、2027年の収益は少なくとも1兆ドル、ロブスターが新しいオペレーティングシステムです。

2026年3月16日、NVIDIA GTC 2026大会が正式に開幕し、NVIDIAの創業者兼CEOである黄仁勲が基調講演を行いました。

この「AI業界の年次巡礼」と見なされる大会で、黄仁勲はNVIDIAが「チップ会社」から「AIインフラストラクチャおよび工場会社」への変革を説明しました。市場が最も関心を持つ業績の持続性と成長の余地について、黄仁勲は未来の成長を促進する基盤ビジネスロジック「トークン工場経済学」を詳細に解説しました。

業績の指針は非常に楽観的で、「2027年までに少なくとも1兆ドルの需要」

過去2年間、世界のAI計算需要は指数関数的に爆発的に増加しました。大規模モデルが「認識」や「生成」から「推論」と「行動(タスクの実行)」へと進化する中で、計算能力の消費量は急激に増加しています。市場が非常に注目している受注と収益の天井に対して、黄仁勲は非常に強力な予測を示しました。

黄仁勲は講演の中で率直に述べました:

昨年の今頃、私たちは5000億ドルの高い確信を持った需要を見込んでいると言いました。これはBlackwellとRubinを2026年までカバーしています。今、ここで、私は2027年までに少なくとも1兆ドルの需要を見込んでいます(at least $1 trillion)。

黄仁勲の1兆ドルの予測は、一時的にNVIDIAの株価を4.3%以上押し上げました。

さらに、彼はこの数字について次のように補足しました:

これは合理的ですか?これが私が次に話すことです。実際、私たちは供給不足になるでしょう。私は、実際の計算需要はこれよりもはるかに高いと確信しています。

黄仁勲は、今日のNVIDIAシステムが世界で「コスト最安のインフラ」であることを証明したと指摘しました。NVIDIAはほぼすべての分野のAIモデルを実行できるため、この汎用性により顧客が投資する1兆ドルが十分に活用され、長期的なライフサイクルを維持できるのです。

現在、NVIDIAの60%のビジネスは、上位5社の超大規模クラウドサービスプロバイダーから来ており、残りの40%は主権クラウド、企業、産業、ロボット、エッジコンピューティングなどのさまざまな分野に広がっています。

トークン工場経済学、ワットあたりの性能がビジネスの命脈を決定する

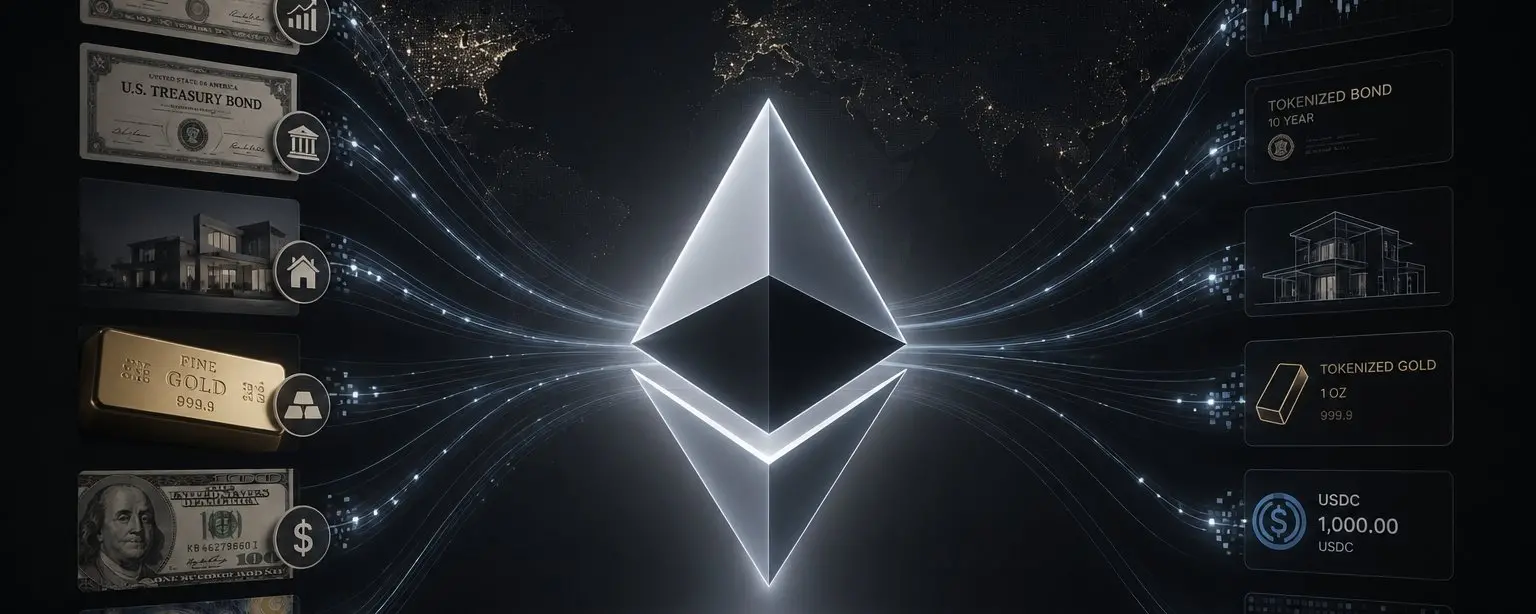

この1兆ドルの需要の合理性を説明するために、黄仁勲は世界の企業CEOに新しいビジネス思考を示しました。彼は、未来のデータセンターはもはやファイルを保存する倉庫ではなく、トークン(AI生成の基本単位)を生産する「工場」であると指摘しました。

黄仁勲は強調しました:

各データセンター、各工場は、定義上、電力に制約されています。1GW(ギガワット)の工場は決して2GWにはなりません。これは物理と原子の法則です。固定された電力の下で、誰のワットあたりのトークンスループットが最も高いかが、誰の生産コストを最も低くします。

黄仁勲は未来のAIサービスを4つのビジネスレベルに分けました:

- 無料層(高スループット、低速度)

- 中級層(~百万トークンあたり3ドル)

- 高級層(~百万トークンあたり6ドル)

- 高速層(~百万トークンあたり45ドル)

- 超高速層(~百万トークンあたり150ドル)

彼は、モデルがますます大きくなり、コンテキストが長くなるにつれて、AIはより賢くなるが、トークンの生成速度は低下すると指摘しました。黄仁勲は述べました:

このトークン工場では、あなたのスループットとトークン生成速度が、あなたの来年の正確な収入に直接変換されます。

黄仁勲は、NVIDIAのアーキテクチャが顧客に無料層で非常に高いスループットを実現させる一方で、最高価値の推論レベルで35倍の性能向上をもたらすことができると強調しました。

Vera Rubinが2年で350倍の加速を実現、Groqが超高速推論を補完

この物理的限界の制約の中で、NVIDIAは史上最も複雑なAI計算システムであるVera Rubinを紹介しました。黄仁勲は述べました:

以前Hopperについて言及するとき、私はチップを持ち上げていました。それは可愛かった。しかしVera Rubinについて言及するとき、皆が思い浮かべるのは全体のシステムです。この100%液冷で、従来のケーブルを完全に排除したシステムでは、以前は2日かかっていたラックの設置が、今ではわずか2時間で済みます。

黄仁勲は、極限のエンドツーエンドのソフトウェアとハードウェアの協調設計を通じて、Vera Rubinが同じ1GWデータセンター内で驚異的なデータの飛躍を生み出したと述べました:

わずか2年で、私たちはトークンの生成速度を2200万から7億に引き上げ、350倍の成長を実現しました。ムーアの法則は同時期に約1.5倍の向上しかもたらしませんでした。

超高速推論(例えば1000トークン/秒)の条件下での帯域幅のボトルネックを解決するために、NVIDIAは買収したGroqの統合ソリューションを提供しました:非対称の分離推論。黄仁勲は説明しました:

この2つのプロセッサの特徴は全く異なります。Groqチップは500MBのSRAMを持ち、Rubinチップは288GBのメモリを持っています。

黄仁勲は、NVIDIAがDynamoソフトウェアシステムを通じて、大量の計算とビデオメモリを必要とする「プレフィル(Pre-fill)」段階をVera Rubinに、遅延に非常に敏感な「デコード」段階をGroqに割り当てたと指摘しました。黄仁勲は企業の計算力配置について次のように提案しました:

あなたの作業が主に高スループットであるなら、100%Vera Rubinを使用してください。もし大量の高価値のプログラミングレベルのトークン生成需要があるなら、データセンターの規模の25%をGroqに割り当ててください。

Samsungが製造したGroq LP30チップはすでに量産に入っており、第三四半期に出荷が予定されています。また、最初のVera RubinラックはMicrosoft Azureで稼働しています。

さらに、光相互接続技術に関して、黄仁勲は世界初の量産共封装光学(CPO)スイッチSpectrum Xを展示し、「銅から光への移行」に関する市場の懸念を払拭しました:

私たちはより多くの銅ケーブルの生産能力、より多くの光チップの生産能力、より多くのCPOの生産能力が必要です。

エージェントが従来のSaaSを終わらせ、「年俸+トークン」がシリコンバレーの標準に

ハードウェアの壁に加えて、黄仁勲はAIソフトウェアとエコシステムの革命、特にエージェント(知能体)の爆発に多くの時間を割きました。

彼はオープンソースプロジェクトOpenClawを「人類史上最も人気のあるオープンソースプロジェクト」と表現し、わずか数週間でLinuxが過去30年で達成した成果を超えたと述べました。黄仁勲は、OpenClawが本質的にエージェントコンピュータの「オペレーティングシステム」であると明言しました。

黄仁勲は断言しました:

すべてのSaaS(ソフトウェアとしてのサービス)会社はAaaS(エージェントとしてのサービス)会社に変わるでしょう。間違いなく、敏感なデータにアクセスし、コードを実行する能力を持つこのようなエージェントを安全に実装するために、NVIDIAは企業向けのNeMo Clawリファレンスデザインを導入し、戦略エンジンとプライバシールーターを追加しました。

一般の職場の人々にとっても、この変革はすぐそこにあります。黄仁勲は未来の職場の新しい形態を描きました:

将来的には、私たちの会社のすべてのエンジニアが年間トークン予算を持つ必要があります。彼らの基本年俸は数十万ドルかもしれませんが、その基盤の上に約半分の金額をトークンの枠として提供し、彼らの効率を10倍に引き上げます。これがシリコンバレーの新しい採用の駆け引きです:あなたのオファーにはどれだけのトークンが含まれていますか?

講演の最後に、黄仁勲は次世代計算アーキテクチャFeynmanについて「ネタバレ」し、初めて銅線とCPOの共同水平拡張を実現すると述べました。さらに、NVIDIAは宇宙に展開するデータセンターコンピュータ「Vera Rubin Space-1」を開発中であり、AI計算力が地球の外に広がる想像の空間を完全に開きました。

黄仁勲GTC 2026講演全文、全文翻訳は以下の通りです(AIツール支援):

司会者: NVIDIAの創業者兼CEOである黄仁勲をお迎えします。

黄仁勲、創業者兼CEO:

GTCへようこそ。これは技術会議であることを皆さんに思い出していただきたいです。こんなに多くの人が朝早くから並んで入場しているのを見て、皆さんにお会いできて非常に嬉しいです。

GTCでは、3つの主要テーマに焦点を当てます:技術、プラットフォーム、エコシステム。NVIDIAは現在、3つのプラットフォームを持っています:CUDA-Xプラットフォーム、システムプラットフォーム、そして最新のAI工場プラットフォームです。

正式に始める前に、私たちのプレヒートセッションの司会者であるConvictionのSarah Guo、Sequoia CapitalのAlfred Lin(NVIDIAの最初のベンチャーキャピタリスト)、そしてNVIDIAの最初の主要機関投資家であるGavin Bakerに感謝したいと思います。この3人は技術に対する深い洞察を持ち、技術エコシステム全体に広範な影響力を持っています。もちろん、今日私が直接招待したすべてのゲストにも感謝します。このオールスターチームに感謝します。

今日出席しているすべての企業にも感謝します。NVIDIAはプラットフォーム会社であり、技術、プラットフォーム、豊富なエコシステムを持っています。今日出席している企業は、100兆ドルの業界のほぼすべての参加者を代表しており、450社がこのイベントをスポンサーしています。心から感謝します。

この大会では、1,000の技術フォーラム、2,000人の講演者があり、人工知能の「5層ケーキ」アーキテクチャのすべてのレベルをカバーします------土地、電力、データセンターなどのインフラから、チップ、プラットフォーム、モデル、そして最終的に業界全体を飛躍させるさまざまなアプリケーションまで。

CUDA:20年の技術の蓄積

すべての始まりはここにあります。今年はCUDAの誕生から20周年です。

20年間、私たちはこのアーキテクチャの研究開発に取り組んできました。CUDAは革命的な発明であり------SIMT(単一命令多スレッド)技術は、開発者がスカラーコードでプログラムを記述し、それをマルチスレッドアプリケーションに拡張することを可能にし、そのプログラミングの難易度は以前のSIMDアーキテクチャよりもはるかに低いです。最近、私たちはTiles機能を追加し、開発者がテンソルコア(Tensor Core)をより便利にプログラムできるようにし、今日の人工知能が依存するさまざまな数学的演算構造をサポートしています。現在、CUDAは数千のツール、コンパイラ、フレームワーク、ライブラリを持ち、オープンソースコミュニティには数十万の公開プロジェクトが存在し、すべての技術エコシステムに深く統合されています。

このグラフは、NVIDIAの100%の戦略ロジックを明らかにし、私は最初からこのスライドを話してきました。その中で最も実現が難しく、最も核心的な要素は、グラフの底部にある「装置数」です。20年の間に、私たちは世界中で数億のCUDAを実行するGPUと計算システムを蓄積してきました。

私たちのGPUはすべてのクラウドプラットフォームをカバーし、ほぼすべてのコンピュータメーカーや業界にサービスを提供しています。CUDAの膨大な装置数は、このフライホイールが継続的に加速する根本的な理由です。装置数は開発者を引き寄せ、開発者は新しいアルゴリズムを創造し、突破口を開き、新しい市場を生み出し、新しいエコシステムを形成し、さらに多くの企業を引き寄せ、装置数を拡大します------このフライホイールは加速し続けています。

NVIDIAライブラリのダウンロード数は驚異的な速度で増加しており、規模が大きく、成長速度も向上しています。このフライホイールは、私たちの計算プラットフォームが膨大なアプリケーションと次々と現れる新しい突破口を支えることを可能にしています。

さらに重要なのは、これらのインフラストラクチャに非常に長い使用寿命を与えることです。その理由は明白です:NVIDIA CUDA上で実行できるアプリケーションは非常に豊富で、AIライフサイクルの各段階、さまざまなデータ処理プラットフォーム、さまざまな科学原理の解決策をカバーしています。したがって、一度NVIDIA GPUがインストールされると、その実際の使用価値は非常に高くなります。これが、私たちが6年前に発表したAmpereアーキテクチャのGPUが、クラウドでの価格が上昇している理由でもあります。

すべての根本的な理由は:装置数が膨大で、フライホイールが強力で、開発者エコシステムが広範であることです。これらの要因が共同で作用し、私たちがソフトウェアを継続的に更新することで、計算コストが低下し続けます。加速計算はアプリケーションの性能を大幅に向上させる一方で、私たちが長期にわたりソフトウェアを維持し、反復することで、ユーザーは初期に性能の飛躍を得るだけでなく、計算コストの低下を継続的に享受できます。私たちは、世界中のすべてのGPUに長期的なサポートを提供する意欲があります。なぜなら、それらはアーキテクチャ的に完全に互換性があるからです。

私たちがこのようにする理由は、装置数が非常に膨大であるからです------新しい最適化を発表するたびに、数百万のユーザーに恩恵をもたらすことができます。この動的な組み合わせにより、NVIDIAアーキテクチャは継続的にカバレッジを拡大し、自身の成長を加速しながら、計算コストを低下させ、新たな成長を刺激します。CUDAはこのすべての中心です。

GeForceからCUDAへ:25年の進化の道

私たちのCUDAの旅は、実際には25年前に始まりました。

GeForce------ここにいる多くの人々はGeForceと共に成長してきたことでしょう。GeForceはNVIDIAの最も成功したマーケティングプロジェクトです。私たちは、あなたたちがまだ製品を買えなかった頃から、未来の顧客を育ててきました------あなたたちの親が代わりにNVIDIAの最初のユーザーとなり、年々私たちの製品を購入し続け、ある日あなたたちが優れたコンピュータ科学者に成長し、真の顧客と開発者になるまで。

これは25年前にGeForceが築いた基盤です。25年前、私たちはプログラム可能なシェーダーを発明しました------これは加速器をプログラム可能にするための明白でありながらも意義深い発明であり、世界初のプログラム可能な加速器、すなわちピクセルシェーダーです。その5年後、私たちはCUDAを創造しました------これは私たちの歴史の中で最も重要な投資の1つです。当時、会社の財政は限られていましたが、私たちは利益の大部分をこのプロジェクトに賭け、GeForceからすべてのコンピュータにCUDAを拡張することに専念しました。私たちがこのように確信を持っていたのは、その潜在能力を深く信じていたからです。初期には苦労しましたが、会社はこの信念を13世代、20年にわたって守り続け、今やCUDAはどこにでも存在しています。

まさにピクセルシェーダーがGeForceの革命を推進しました。そして約8年前、私たちはRTXを発表し------現代のコンピュータグラフィックス時代に対するアーキテクチャの全面的な革新を行いました。GeForceはCUDAを全世界に広め、Alex Krizhevsky、Ilya Sutskever、Geoffrey Hinton、Andrew Ngなどの多くの学者がGPUが深層学習を加速するための強力なツールになることを発見し、これにより10年前の人工知能の大爆発が引き起こされました。

10年前、私たちはプログラム可能なシェーダーと2つの全く新しいアイデアを融合させることを決定しました:1つはハードウェアのレイトレーシング(Ray Tracing)で、これは技術的に非常に挑戦的です;もう1つは、当時非常に先見の明のあるアイデア------約10年前、私たちはAIがコンピュータグラフィックスを根本的に変革することを予見しました。まさにGeForceがAIを全世界に広めたように、AIも今やコンピュータグラフィックスの実現方法を再形成しています。

今日は、皆さんに未来をお見せしたいと思います。これは私たちの次世代グラフィックス技術で、神経レンダリング(Neural Rendering)と呼ばれます------3Dグラフィックスと人工知能の深い融合です。これがDLSS 5です、見てください。

神経レンダリング:構造化データと生成AIの融合

これは驚くべきことではありませんか?コンピュータグラフィックスが新たな命を吹き込まれました。

私たちは何をしたのでしょうか?私たちは制御可能な3Dグラフィックス(仮想世界の真実の基盤)をその構造化データと組み合わせ、さらに生成AIと確率計算を取り入れました。完全に決定論的なものと、確率的でありながら非常にリアルなもの------私たちはこれら2つの概念を統合し、構造化データを通じて精密に制御し、リアルタイムで生成を行います。最終的に、コンテンツは美しく驚異的であり、完全に制御可能です。

構造化情報と生成AIの融合というこの概念は、さまざまな業界で繰り返されることでしょう。構造化データは信頼できるAIの基盤です。

構造化データと非構造化データの加速プラットフォーム

今、技術アーキテクチャの図を見ていただきたいと思います。

構造化データ------皆さんがよく知っているSQL、Spark、Pandas、Velox、Snowflake、Databricks、Amazon EMR、Azure Fabric、Google BigQueryなどの重要なプラットフォームは、データフレーム(Data Frame)を処理しています。これらのデータフレームは巨大な電子スプレッドシートのようなもので、ビジネス界のすべての情報を担い、企業計算の基本的な事実(Ground Truth)です。

AI時代において、AIが構造化データを使用し、それを極限まで加速する必要があります。過去には、構造化データ処理の加速は企業の運営をより効率的にするためのものでした。しかし未来において、AIは人間をはるかに超える速度でこれらのデータ構造を使用し、AIエージェントも構造化データベースを大量に呼び出すことになります。

非構造化データに関しては、ベクトルデータベース、PDF、ビデオ、音声などが世界のほとんどのデータ形態を構成しています------毎年生成されるデータの約90%は非構造化データです。過去には、これらのデータはほとんど利用できませんでした:私たちはそれらを読み取り、ファイルシステムに保存するだけでした。私たちはクエリを実行することも、検索することもできませんでした。その理由は、非構造化データには簡単なインデックス方式が欠けており、その意味と文脈を理解する必要があるからです。しかし今、AIはそれを実現できるのです------マルチモーダルな認識と理解技術を駆使して、AIはPDF文書を読み取り、その意味を理解し、クエリ可能なより大きな構造に埋め込むことができます。

NVIDIAはこのために2つの基盤ライブラリを作成しました:

cuDF:データフレーム、構造化データの加速処理用

cuVS:ベクトルストレージ、意味データ、非構造化AIデータの処理用

これら2つのプラットフォームは、未来の最も重要な基盤プラットフォームの1つとなるでしょう。

今日は、複数の企業との提携を発表します。IBM------SQL言語の発明者は、cuDFを使用してWatsonX Dataプラットフォームを加速します。Dellは私たちと共同でDell AIデータプラットフォームを構築し、cuDFとcuVSを統合し、NTT Dataの実際のプロジェクトで大幅な性能向上を実現しました。Google Cloudでは、私たちは現在、Vertex AIだけでなくBigQueryも加速しており、Snapchatと協力して計算コストを約80%削減しました。

加速計算がもたらす利点は三位一体です:速度、規模、コスト。これはムーアの法則の論理と一脈相承しています------加速計算を通じて性能の飛躍を実現し、同時にアルゴリズムを最適化し続けることで、すべての人が持続的に低下する計算コストを享受できるようになります。

NVIDIAは加速計算プラットフォームを構築し、その上に多くのライブラリが集まっています:RTX、cuDF、cuVSなどです。これらのライブラリは、世界のクラウドサービスやOEMシステムに統合され、世界中のユーザーにアクセスします。

主要クラウドサービスプロバイダーとの深い協力

主要クラウドサービスプロバイダーとの協力

Google Cloud:私たちはVertex AIとBigQueryを加速し、JAX/XLAと深く統合し、PyTorch上でも優れたパフォーマンスを発揮しています------NVIDIAは、PyTorchとJAX/XLAの両方で優れたパフォーマンスを示す唯一の加速器です。私たちはBase10、CrowdStrike、Puma、Salesforceなどの顧客をGoogle Cloudエコシステムに引き入れました。

AWS:私たちはEMR、SageMaker、Bedrockを加速し、AWSと深く統合しています。今年、私が特に興奮しているのは、OpenAIをAWSに引き入れることで、これがAWSクラウドコンピューティングの消費成長を大幅に促進し、OpenAIの地域展開と計算規模を拡大するのに役立つことです。

Microsoft Azure:NVIDIAの100 PFLOPSスーパーコンピュータは、私たちが構築した最初のスーパーコンピュータであり、Azureに展開された最初のスーパーコンピュータでもあります。これがOpenAIとの協力の重要な基盤を築きました。私たちはAzureクラウドサービスとAI Foundryを加速し、Azure地域の拡張を共同で推進し、Bing検索で深く協力しています。特に、私たちの機密計算(Confidential Computing)能力------オペレーターでさえユーザーデータやモデルを確認できないことを保証する------NVIDIA GPUは、世界初の機密計算をサポートするGPUの1つであり、OpenAIやAnthropicモデルを世界各地のクラウド環境で機密に展開することができます。Synopsysの例を挙げると、私たちはそのすべてのEDAとCADワークフローを加速し、Microsoft Azureに展開しました。

Oracle:私たちはOracleの最初のAI顧客であり、OracleにAIクラウドの概念を初めて説明できたことを誇りに思います。その後、彼らは急成長し、私たちはCohere、Fireworks、OpenAIなどの多くのパートナーを引き入れました。

CoreWeave:世界初のAIネイティブクラウドで、GPUホスティングとAIクラウドサービスのために生まれたもので、優れた顧客群を持ち、成長勢いが強いです。

Palantir + Dell:三者共同で全く新しいAIプラットフォームを構築しました。これはPalantirの本体論プラットフォーム(Ontology Platform)とAIプラットフォームに基づいており、どの国でも、どの隔離環境でも、完全にローカライズされたAIを展開できるようにします------データ処理(ベクトル化または構造化)からAIの完全な加速計算スタックまで、すべてを網羅しています。

NVIDIAは世界のクラウドサービスプロバイダーとのこの特別な協力関係を築いています------私たちは顧客をクラウドに引き入れ、これは相互に利益をもたらすエコシステムです。

垂直統合、横方向のオープン:NVIDIAの核心戦略

NVIDIAは世界初の垂直統合、横方向のオープンな会社です。

このモデルの必要性は非常にシンプルです:加速計算はチップの問題でもなく、システムの問題でもなく、その完全な表現はアプリケーションの加速です。CPUはコンピュータ全体をより速く動かすことができますが、この道はすでに瓶 neckに達しています。未来には、アプリケーションや分野特有の加速を通じてのみ、性能の飛躍とコストの低下を持続的に実現できるのです。

これがNVIDIAが一つ一つのライブラリ、一つ一つの分野、一つ一つの垂直産業に深く取り組む必要がある理由です。私たちは垂直統合された計算会社であり、他に道はありません。私たちはアプリケーションを理解し、分野を理解し、アルゴリズムを深く理解し、どんなシーンでもそれを展開できる必要があります------データセンター、クラウド、ローカル、エッジ、さらにはロボットシステムまで。

同時に、NVIDIAは横方向にオープンであり、技術をどんなパートナーのプラットフォームにも統合することを望んでおり、全世界が加速計算の恩恵を享受できるようにしています。

今回のGTCの参加者構造はこれを十分に反映しています。今回の参加者の中で、金融サービス業界の割合が最も高い------開発者が来ることを望んでおり、トレーダーではありません。私たちのエコシステムは、上流と下流のサプライチェーンをカバーしています。50年、70年、150年の企業が、昨年は歴史的な最高の年を迎えました。私たちは非常に重要なことの始まりにいます。

CUDA-X:各業界の加速計算エンジン

さまざまな垂直分野で、NVIDIAはすでに深く展開しています:

自動運転:広範囲にわたり、深い影響を与えています

金融サービス:量的投資は人工的な特徴エンジニアリングからスーパーコンピュータ駆動の深層学習に移行し、「トランスフォーマーの瞬間」を迎えています

医療健康:AI支援の薬物発見、AIエージェントによる診断、医療カスタマーサービスなどの方向性で、自らの「ChatGPTの瞬間」を迎えています

工業:世界最大の建設ブームが展開されており、AI工場、チップ工場、データセンター工場が次々と立ち上がっています

エンターテインメントとゲーム:リアルタイムAIプラットフォームが翻訳、ライブストリーミング、ゲームインタラクション、スマートショッピングエージェントをサポートしています

ロボット:10年以上の深耕を経て、3つのコンピュータアーキテクチャ(トレーニングコンピュータ、シミュレーションコンピュータ、搭載コンピュータ)が整い、今回の展示会では110種類のロボットが登場しました

電気通信:約2兆ドル規模の業界で、基地局は単一の通信機能からAIインフラストラクチャプラットフォームへと進化し、関連プラットフォームはAerialで、Nokia、T-Mobileなどの企業と深く協力しています

これらすべての分野の核心は、私たちのCUDA-Xライブラリです------これはNVIDIAがアルゴリズム会社としての根本です。これらのライブラリは会社の最も核心的な資産であり、計算プラットフォームが各業界で実際の価値を発揮できるようにします。

その中で最も重要なライブラリの1つはcuDNN(CUDA深層神経ネットワークライブラリ)であり、これは人工知能を根本的に革新し、現代AIの大爆発を引き起こしました。

(CUDA-Xデモビデオを再生)

皆さんが見たすべてはシミュレーションです------物理原理に基づくソルバー、AIエージェント物理モデル、物理AIロボットモデルを含みます。すべてはシミュレーションであり、手動アニメーションや関節のバインディングは一切ありません。これがNVIDIAの核心能力です:アルゴリズムの深い理解と計算プラットフォームの有機的な結合を通じて、これらの機会を解放します。

AIネイティブ企業と新しい計算時代

皆さんは、ウォルマート、ロレアル、JPモルガン、ロシュ、トヨタなど、今日の社会を定義する業界の巨人たちを見ました。また、皆さんが聞いたことのない企業もたくさんあります------私たちはこれらをAIネイティブ企業と呼びます。このリストは非常に大きく、OpenAI、Anthropic、さまざまな垂直分野にサービスを提供する新興企業が含まれています。

過去2年間、この業界は驚異的な飛躍を遂げました。リスク投資がスタートアップ企業に流入した資金規模は1,500億ドルに達し、人類史上最高を記録しました。さらに重要なのは、単一の投資規模が初めて数百万ドルから数億ドル、さらには数十億ドルに跳ね上がったことです。理由はただ1つです:これは史上初めて、すべてのこのような企業が大量の計算リソースと大量のトークンを必要とするからです。この業界はトークンを創造し、生成し、またはAnthropic、OpenAIなどの機関からのトークンを価値を高めています。

PC革命、インターネット革命、モバイルクラウド革命がそれぞれ時代を画する企業を生み出したように、この世代の計算プラットフォームの変革もまた、影響力のある企業を生み出し、未来の世界の重要な力となるでしょう。

これを推進する3つの歴史的な突破口

過去2年間に何が起こったのでしょうか?3つの大きな出来事です。

第一:ChatGPT、生成AI時代の幕開け(2022年末から2023年)

それは感知と理解だけでなく、独自のコンテンツを生成することもできます。私は生成AIとコンピュータグラフィックスの融合を示しました。生成AIは根本的に計算の方法を変えました------計算が検索型から生成型に変わり、これはコンピュータアーキテクチャ、展開方法、全体的な意味に深く影響を与えています。

第二:推論AI(Reasoning AI)、o1を代表として

推論能力はAIが自己反省し、計画し、問題を分解することを可能にします------AIが直接理解できない問題を処理可能なステップに分解します。o1は生成AIを信頼できるものにし、実際の情報に基づいて推論を行うことができるようにします。そのため、コンテキストのトークン量と思考に使用される出力トークン量が大幅に増加し、計算量も著しく増加します。

第三:Claude Code、最初のエージェントモデル

それはファイルを読み取り、コードを記述し、コンパイルし、テストし、評価し、反復します。Claude Codeはソフトウェア工学を根本的に革新しました------NVIDIAの100%のエンジニアがClaude Code、Codex、Cursorのいずれかまたは複数を使用しており、AIの助けを借りていないソフトウェアエンジニアはいません。

これは新しい転換点です------あなたはもはやAIに「何か、どこに、どうやって」と尋ねるのではなく、「作成し、実行し、構築する」ようにさせ、ツールを積極的に使用し、ファイルを読み取り、問題を分解し、行動に移すことができるようになります。AIは感知から生成、推論へと進化し、今や実際に仕事を完了できるようになりました。

過去2年間、推論に必要な計算量は約10,000倍増加し、使用量は約100倍増加しました。私は常に、過去2年間の計算需要は100万倍増加したと考えています------これはすべての人の共通の感覚であり、OpenAIの感覚でもあり、Anthropicの感覚でもあります。もしより多くの計算力を得られれば、より多くのトークンを生成でき、収入が増加し、AIがより賢くなるでしょう。推論の転換点はすでに到来しています。

1兆ドルのAIインフラストラクチャ時代

昨年の今頃、私はここで、BlackwellとRubinに対する2026年までの需要と発注に対して高い信頼を持っていると述べました。その規模は約5000億ドルです。今日、GTCから1年後、私はここに立って皆さんにお伝えします:2027年までの見通しとして、私が見ている数字は少なくとも1兆ドルです。そして、実際の計算需要はこれをはるかに上回ると確信しています。

2025:NVIDIAの推論年

2025年はNVIDIAの推論年(Year of Inference)です。私たちは、トレーニングとポストトレーニングの他にも、AIライフサイクルの各段階で卓越性を維持し、投資したインフラストラクチャが持続的に効率的に運用され、使用寿命が長くなるほど、単位コストが低くなることを確保したいと考えています。

同時に、AnthropicとMetaは正式にNVIDIAプラットフォームに参加し、これにより世界のAI計算需要の3分の1を代表しています。オープンソースモデルは最前線に近づいており、どこにでも存在しています。

NVIDIAは現在、すべてのAI分野------言語、生物学、コンピュータグラフィックス、コンピュータビジョン、音声、タンパク質と化学、ロボットなど------のすべてのAIモデルを実行できる唯一のプラットフォームです。エッジでもクラウドでも、どんな言語でも。NVIDIAアーキテクチャはこれらすべてのシーンに対して汎用性を持ち、私たちをコスト最安で信頼度の高いプラットフォームにしています。

現在、NVIDIAの60%のビジネスは世界の上位5社の超大規模クラウドサービスプロバイダーから来ており、残りの40%は地域クラウド、主権クラウド、企業、産業、ロボット、エッジコンピューティングなどのさまざまな分野に広がっています。AIのカバレッジの広さ自体がそのレジリエンスを示しています------これは間違いなく新しい計算プラットフォームの変革です。

Grace BlackwellとNVLink 72:大胆なアーキテクチャの革新

Hopperアーキテクチャが絶頂期にある中で、私たちはシステムを完全に再構築することを決定し、NVLinkを8路からNVLink 72に拡張し、計算システムを全面的に分解再構築しました。Grace Blackwell NVLink 72は、すべてのパートナーにとって大きな技術的賭けであり、ここで皆さんに心から感謝申し上げます。

同時に、私たちはNVFP4を発表しました------これは単なるFP4ではなく、新しいタイプのテンソルコアと計算ユニットです。私たちは、NVFP4が精度の損失なしに推論を実現し、同時に大きな性能向上とエネルギー効率の向上をもたらすことを証明しました。また、トレーニングにも適用可能です。さらに、DynamoやTensorRT-LLMなどの一連の新しいアルゴリズムが次々と登場し、最適化カーネルのために数十億ドルを投資してDGX Cloudと呼ばれるスーパーコンピュータを建設しました。

その結果、私たちの推論性能は注目に値します。Semi Analysisからのデータ------これはこれまでで最も包括的なAI推論性能評価です------は、NVIDIAがワットあたりのトークン数とトークンあたりのコストの両方の次元で圧倒的にリードしていることを示しています。元々、ムーアの法則はH200に1.5倍の性能向上をもたらす可能性がありましたが、私たちは35倍を達成しました。Semi AnalysisのDylan Patelは、「黄仁勲は控えめだった、実際には50倍だ」とさえ言いました。彼の言う通りです。

私は彼の言葉を引用します:「Jensenは控えめだった(黄仁勲は保守的に報告した)。」

NVIDIAのトークンあたりのコストは世界で最も低く、現在誰も追いつけません。その理由は、極限の協調設計(Extreme Co-design)にあります。

Fireworksの例を挙げると、NVIDIAが全セットのソフトウェアとアルゴリズムを更新する前、その平均トークン速度は約700トークン/秒でした;更新後は約5,000トークン/秒に近づき、約7倍の向上を実現しました。これが極限の協調設計の力です。

AI工場:データセンターからトークン工場へ

データセンターはかつてファイルを保存する場所でしたが、今やトークンを生産する工場です。すべてのクラウドサービスプロバイダー、すべてのAI企業は、今後「トークン工場の効率」を核心的な経営指標として位置づけることになります。

これが私の核心的な主張です:

縦軸:スループット(Throughput)------固定された電力の下で毎秒生成されるトークン数

横軸:インタラクション速度(Token Speed)------各推論の応答速度、速度が速いほど、使用可能なモデルが大きく、コンテキストが長くなり、AIがより賢くなります

トークンは新しいコモディティであり、一旦成熟すれば階層的に価格設定されます:

無料層(高スループット、低速度)

中級層(~百万トークンあたり3ドル)

高級層(~百万トークンあたり6ドル)

高速層(~百万トークンあたり45ドル)

超高速層(~百万トークンあたり150ドル)

Hopperと比較して、Grace Blackwellは最高価値層で35倍のスループットを向上させ、新しい層を導入しました。モデルを簡略化して推定すると、25%の電力を4つの層にそれぞれ配分することで、Grace BlackwellはHopperよりも5倍の収益を生み出すことができます。

Vera Rubin:次世代AI計算システム

(Vera Rubinシステム紹介ビデオを再生)

Vera Rubinは完全なエンドツーエンドの最適化されたシステムで、エージェント(Agentic)ワークロードのために設計されています:

大規模言語モデル計算コア:NVLink 72 GPUクラスター、プレフィル(Prefill)とKVキャッシュを処理

新しいVera CPU:非常に高い単一スレッド性能のために設計され、LPDDR5メモリを使用し、卓越したエネルギー効率を持ち、世界で唯一LPDDR5を使用するデータセンターCPUであり、AIエージェントツールの呼び出しに適しています

ストレージシステム:BlueField 4 + CX 9、AI時代のための新しいストレージプラットフォーム、世界のストレージ業界が100%参加

CPO Spectrum Xスイッチ:世界初の共封装光学イーサネットスイッチで、すでに全面的に量産されています

Kyberラック:新しいラックシステムで、144枚のGPUを単一のNVLinkドメインに組み合わせ、前面計算と後面NVLinkスイッチを形成し、巨大なコンピュータを構成します

Rubin Ultra:次世代スーパーコンピュータノードで、垂直挿入型デザインで、Kyberラックと組み合わせて、より大規模なNVLink相互接続をサポートします

Vera Rubinは100%液冷で、設置時間が2日から2時間に短縮され、45°Cの温水冷却を採用し、データセンターの冷却圧力を大幅に軽減します。このSatya(ナデラ)はすでに文書を発表し、最初のVera RubinラックがMicrosoft Azureで稼働していることを確認しました。私はこれに非常に興奮しています。

Groq統合:推論性能の極限の延長

私たちはGroqチームを買収し、その技術ライセンスを取得しました。Groqは決定論的データフロープロセッサ(Deterministic Dataflow Processor)で、静的コンパイルとコンパイラスケジューリングを採用し、大量のSRAMを持ち、単一の推論ワークロードに最適化されており、極低遅延と非常に高いトークン生成速度を持っています。

しかし、Groqのメモリ容量は限られており(500MBのオンチップSRAM)、大規模モデルのパラメータとKVキャッシュを独立して保持することができず、大規模なアプリケーションに制限をかけています。

解決策はDynamoです------推論スケジューリングソフトウェアです。私たちはDynamoを通じて推論パイプラインを解聚(Disaggregate)しました:

プレフィル(Prefill)および注意メカニズムのデコード(Decode)はVera Rubinで完了します(大量の計算力とKVキャッシュストレージが必要です)

前方伝播ネットワークデコード(Feed-Forward Network Decode)、すなわちトークン生成部分はGroqで完了します(極めて高い帯域幅と低遅延が必要です)

両者はイーサネットを介して密接に結合され、特殊なモードを使用して遅延を約半分に削減します。Dynamoという「AI工場オペレーティングシステム」の統一スケジューリングの下で、全体の性能が35倍向上し、NVLink 72がこれまで触れられなかった新しい推論性能レベルを開拓しました。

GroqとVera Rubinの組み合わせの提案:

ワークロードが高スループットを主に必要とする場合は、100%Vera Rubinを使用してください

大量のワークロードがコード生成などの高価値トークン生成である場合は、Groqを導入することをお勧めします。推奨比率は約25%Groq + 75%Vera Rubinです。

Groq LP30はSamsungが製造しており、現在量産に入っており、Q3から出荷が始まる予定です。Samsungの全面的な協力に感謝します。

推論性能の歴史的な飛躍

これまでの技術進歩を定量化すると:2年間で、1GWのAI工場のトークン生成速度は2200万トークン/秒から7億トークン/秒に向上し、350倍の向上を実現しました。これが極限の協調設計の力です。

技術ロードマップ

Blackwell:現在生産中、Oberon標準ラックシステム、銅ケーブルがNVLink 72に拡張、光学的にNVLink 576に拡張可能

Vera Rubin(現在):Kyberラック、NVLink 144(銅ケーブル);Oberonラック、NVLink 72 + 光学、NVLink 576に拡張;Spectrum 6、世界初のCPOスイッチ

Vera Rubin Ultra(近日発売):次世代Rubin Ultra GPU、LP35チップ(初めてNVFP4を統合)、さらなる性能向上を実現

Feynman(次世代):全く新しいGPU、LP40チップ(NVIDIAとGroqチームが共同で開発し、NVFP4を統合);新しいCPU------Rosa(Rosalyn);BlueField 5;CX 10;銅ケーブルとCPOの両方の拡張方式をサポートするKyberラック

ロードマップは明確です:銅ケーブルの拡張、光学の拡張(Scale-Up)、光学の拡張(Scale-Out)の3つのルートが並行して進行しており、私たちはすべてのパートナーに銅ケーブル、光ファイバー、CPOの生産能力を拡大し続けることを求めています。

NVIDIA DSX:AI工場のデジタルツインプラットフォーム

AI工場はますます複雑になっていますが、それを構成するさまざまな技術供給者は、設計段階で相互に協力したことがなく、データセンターで「出会う」までのことが明らかに不十分でした。

そのため、私たちはOmniverseを作成し、その上にNVIDIA DSXプラットフォームを構築しました------これはすべてのパートナーが仮想世界でギガワット級のAI工場を共同で設計し運営するためのプラットフォームです。DSXは以下を提供します:

ラックレベルの機械、熱学、電気、ネットワークシミュレーションシステム

電力網との接続を実現し、協調的なエネルギー効率の最適化を行います

データセンター内でのMax-Qに基づく動的な電力消費と冷却の最適化

保守的に見積もっても、このシステムはエネルギー利用効率を約2倍向上させることができ、私たちが話している規模では非常に顕著な利益です。Omniverseはデジタル地球から始まり、さまざまな規模のデジタルツインを支え、私たちは世界中のパートナーと共に人類史上最大のコンピュータを構築しています。

さらに、NVIDIAは宇宙に進出しています。Thorチップは放射線認証を通過し、衛星内で稼働しています。私たちはパートナーと共に、宇宙データセンターの構築に使用するVera Rubin Space-1を開発しています。宇宙では放射線散熱に依存するしかなく、熱管理が核心的な課題であり、私たちはトップエンジニアを集めて解決に取り組んでいます。

OpenClaw:エージェント時代のオペレーティングシステム

Peter SteinbergerはOpenClawというソフトウェアを開発しました。これは人類史上最も人気のあるオープンソースプロジェクトであり、わずか数週間でLinuxの30年の成果を超えました。

OpenClawは本質的にエージェントシステム(Agentic System)であり、次のことができます:

リソースを管理し、ツール、ファイルシステム、大規模言語モデルにアクセスする

スケジューリングや定期的なタスクを実行する

問題を段階的に分解し、サブエージェントを呼び出す

任意のモダリティの入力出力(音声、ビデオ、テキスト、メールなど)をサポートする

オペレーティングシステムの文法で説明すると、これは確かにオペレーティングシステムです------エージェントコンピュータのオペレーティングシステムです。Windowsが個人コンピュータを可能にしたように、OpenClawは個人エージェントを可能にします。

すべての企業は自社のOpenClaw戦略を策定する必要があります。私たちがLinux戦略、HTML戦略、Kubernetes戦略を必要とするのと同じように。

企業ITの全面的な再構築

OpenClaw以前の企業IT:データとファイルがシステムに入り、ツールやワークフローを経て、最終的に人間が使用するツールに変わります。ソフトウェア会社はツールを作成し、システムインテグレーター(GSI)やコンサルティング会社が企業がこれらのツールを使用するのを助けます。

OpenClaw以降の企業IT:すべてのSaaS会社はAaaS(エージェントとしてのサービス)会社に変わります------単にツールを提供するのではなく、特定の分野に特化したAIエージェントを提供します。

しかし、ここには重要な課題があります:企業内部のエージェントは敏感なデータにアクセスし、コードを実行し、外部と通信することができます。これは企業環境で厳格に管理される必要があります。

そのため、私たちはPeterと協力し、セキュリティを企業向けバージョンに組み込み、次のものを導入しました:

NeMo Claw(リファレンスデザイン):OpenClawに基づく企業向けリファレンスフレームワークで、NVIDIAの全セットのエージェントAIツールキットを統合しています

Open Shield(セキュリティレイヤー):OpenClawに統合され、戦略エンジン、ネットワークバリア、プライバシールーターを提供し、企業データの安全を確保します

NeMo Cloud:ダウンロード可能で、すべてのSaaS企業の戦略エンジンと接続されます

これは企業ITのルネサンスであり、もともと2兆ドル規模の産業が数兆ドル規模に成長し、ツールの提供から専門的なAIエージェントサービスの提供へと移行します。

私は完全に予見できます:将来的には、会社のすべてのエンジニアが年間トークン予算を持つことになります。彼らの年俸は数十万ドルかもしれませんが、その半分に相当するトークン枠を追加し、彼らの生産性を10倍に引き上げます。「入社時にどれだけのトークン枠が付いているか」がシリコンバレーの新しい採用の話題になっています。

すべての企業は将来的にトークンの使用者(エンジニアが使用する)であり、トークンの生産者(顧客にサービスを提供する)でもあります。OpenClawの意義は過小評価できず、HTMLやLinuxと同じくらい重要です。

NVIDIAオープンモデルイニシアティブ

カスタムエージェント(Custom Claw)に関して、私たちはNVIDIAが独自に開発した最前線のモデルを提供します:

モデル領域Nemotron大規模言語モデルCosmos世界基盤モデルGROOT汎用人型ロボットモデルAlpamayo自動運転BioNeMoデジタル生物学Phys-AIAI物理

私たちは各分野で技術の最前線に立っており、継続的な反復を約束します------Nemotron 3の後にはNemotron 4があり、Cosmos 1の後にはCosmos 2があり、Groqも第二世代に進化します。

Nemotron 3はOpenClawで世界の三大ベストモデルの1つにランクインしており、最前線のレベルにあります。Nemotron 3 Ultraは史上最強の基盤モデルとなり、各国が主権AIを構築するのをサポートします。

今日はNemotron連合を設立し、AI基盤モデルの研究開発を推進するために数十億ドルを投資することを発表します。連合メンバーには、BlackForest Labs、Cursor、LangChain、Mistral、Perplexity、Reflection、Sarvam(インド)、Thinking Machines(Mira Muratiのラボ)などが含まれます。次々と企業ソフトウェア会社が参加し、NeMo ClawリファレンスデザインとNVIDIAエージェントAIツールキットを自社製品に統合しています。

物理AIとロボット

デジタルエージェントはデジタル世界で行動します------コードを記述し、データを分析します;一方、物理AIは具現化されたエージェント、つまりロボットです。

今回のGTCでは110種類のロボットが登場し、ほぼすべてのロボット開発企業を網羅しています。NVIDIAは3台のコンピュータ(トレーニングコンピュータ、シミュレーションコンピュータ、搭載コンピュータ)と完全なソフトウェアスタックおよびAIモデルを提供しています。

自動運転に関しては、自動運転の「ChatGPTの瞬間」がすでに到来しています。今日は、4社の新しいパートナーがNVIDIA RoboTaxi Readyプラットフォームに参加することを発表します:BYD、現代自動車、日産、Geelyで、合計年産量は1800万台です。以前のメルセデス、トヨタ、ゼネラルモーターズと合わせて、陣容がさらに強化されました。私たちは同時にUberとの重要な提携を発表し、複数の都市でRoboTaxi Ready車両を展開し接続します。

産業用ロボットに関しては、ABB、Universal Robotics、KUKAなどの多くのロボット企業が私たちと協力し、物理AIモデルとシミュレーションシステムを組み合わせて、ロボットの世界的な製造ラインへの導入を推進しています。

電気通信に関しては、キャタピラー(Caterpillar)やT-Mobileもその中に含まれています。未来には、無線基地局は単なる通信ノードではなく、NVIDIA Aerial AI RAN------トラフィックをリアルタイムで感知し、ビームフォーミングを調整し、エネルギー効率を向上させるインテリジェントなエッジコンピューティングプラットフォームとなります。

特別セッション:Olafロボットの登場

(Disney Olafロボットデモビデオを再生)

黄仁勲:雪だるまが登場しました!Newtonは正常に動作しています!Omniverseも正常に動作しています!Olaf、元気ですか?

Olaf:あなたに会えて本当に嬉しいです。

黄仁勲:はい、私があなたにコンピュータを与えたからです------Jetson!

Olaf:それは何ですか?

黄仁勲:あなたの腹の中にあります。

Olaf:それは素晴らしいです。

黄仁勲:あなたはOmniverseの中で歩くことを学びました。

Olaf:私は歩くのが好きです。これはトナカイに乗って美しい空を見上げるよりもずっと良いです。

黄仁勲:それは物理シミュレーションのおかげです------NVIDIA Warpに基づいて動作するNewtonソルバーで、これは私たちがDisneyとDeepMindと共同で開発したもので、あなたがリアルな物理世界に適応できるようにします。

Olaf:私はそれを言おうとしていました。

黄仁勲:それがあなたの賢いところです。私は雪だるまです、雪球ではありません。

黄仁勲:想像できますか?未来のディズニーパーク------すべてのロボットキャラクターがパーク内を自由に歩き回ることです。しかし正直に言うと、あなたはもっと背が高いと思っていました。私はこんなに背の低い雪だるまを見たことがありません。

Olaf:(無言)

黄仁勲:今日の講演を終わらせるのを手伝ってくれませんか?

Olaf:素晴らしいです!

基調講演のまとめ

黄仁勲:今日は、私たちは以下の核心テーマについて共に探討しました:

推論の転換点の到来:推論はAIの最も核心的なワークロードとなり、トークンは新しいコモディティであり、推論性能が収入を直接決定します

AI工場時代:データセンターはファイルストレージ施設からトークン生産工場へと進化し、今後すべての企業は「AI工場の効率」で自社の競争力を測ることになります

OpenClawエージェント革命:OpenClawはエージェント計算時代を開き、企業ITはツール時代からエージェント時代へと移行し、すべての企業がOpenClaw戦略を策定する必要があります

物理AIとロボット:具現化された知能が規模化され、自動運転、産業用ロボット、人型ロボットが物理AIの次の大きな機会を構成します

皆さんに感謝します、GTCを楽しんでください!